基盤モデルとは

「基盤モデル×Robotics」 Advent Calendar 2022 1日目

はじめに

みなさんはじめまして.TRAILの小林聖人と申します.

ご覧頂きありがとうございます!

また, 「基盤モデル×Robotics」のAdvent Calendarにご参加して頂き, ありがとうございます!

本記事は東京大学松尾豊研究室のサブグループであるTRAILのテックブログでご紹介させて頂いております!

TRAIL ロボコン大会実績

- ロボカップジャパンオープン@home2020 DSPL初出場 テクニカルチャレンジ優勝・総合準優勝の2冠

- WRS (World Robot Summit) 2020 Partner Robot Challenge 準優勝

本題へ

本記事の構成

目次

☆ 基盤モデルとは?

▷ 基盤モデルの例

☆ おわりに

☆ 参考文献

本記事では前半に基盤モデルについてお伝えした後に, 後半に基盤モデルの活用事例についてお話します.

本記事を読むことで, 基盤モデルの概要を把握して頂く事をを目指します. 是非とも楽しんで頂ければ幸いです!コメント等もお待ちしております!

それでは「基盤モデルの世界」へご案内いたします!

☆ 基盤モデルとは

▷ 命名「基盤モデル foundation model」

近年, 大量のデータで学習した大規模モデルであるCLIP,BERT,GPT-3等が登場し, 大きなパラダイムシフトを起こしています. これらは, 2021年にBommasaniらのスタンフォード大学のワーキンググループによって, 基盤モデル foundation modelと命名されました.Bommasaniらが公表している「On the Opportunities and Risks of Foundation Models」という論文に, 基盤モデル関して以下のような記載があります.

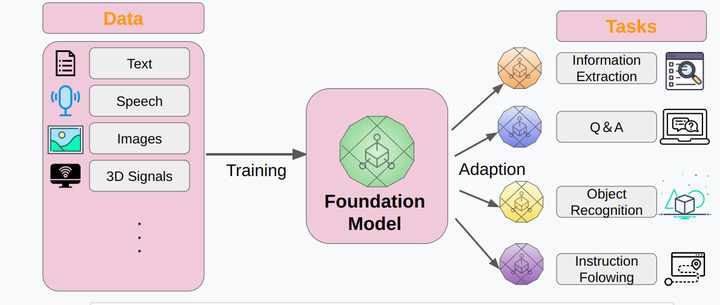

A foundation model is any model that is trained on broad data (generally using self-supervision at scale) that can be adapted (e.g., fine-tuned) to a wide range of downstream tasks

つまり, 基盤モデルとは 「大量で多様なデータを用いて訓練され, 様々なタスクに適応(ファインチューニングなど)できる大規模モデル」 のことです.

▷ 基盤モデルが台頭した訳

基盤モデルは, 多様かつ大規模なデータで学習した大規模モデルです. つまり所望な基盤モデルがありさえすれば, fine-tuneして転移学習したり, ゼロショットでそのまま推論させることで, 様々なタスクに活用できます.

基盤モデルは多様かつ大規模なデータで学習した大規模モデルです. 大規模なデータで学習するために, 表現力が高く, 幅広い応用が可能であり, 様々なドメインで学習した基盤モデルを構築すれば, 基盤モデル1つで多様なドメインを網羅することができます. つまり, 従来の「単一タスク, 単一モデル」から「多様なタスク, 汎化モデル(基盤モデル)」と活用することが可能となり, タスク毎にモデルを設計する必要なくなります.

では, 何故上述のような事が可能となったのでしょうか・・・?

それには以下のような理由があります.

Transfer learning is what makes foundation models possible, but scale is what makes them powerful. Scale required three ingredients: (i) improvements in computer hardware — e.g., GPU throughput and memory have increased 10× over the last four years (§4.5: systems); (ii) the development of the Transformer model architecture [Vaswani et al. 2017] that leverages the parallelism of the hardware to train much more expressive models than before (§4.1: modeling); and (iii) the availability of much more training data.

引用「On the Opportunities and Risks of Foundation Models」

つまり, 上記等を要約しますと, 基盤モデルが台頭した訳は以下3点が挙げられます.

- ハードウェア性能・能力とソフトウェアの最適化

- Transformerモデルの発明

- 大規模データの利活用

Transformerとはエンコーダ/デコーダ構造のモデル.attentionを積極的に活用したモデルです.

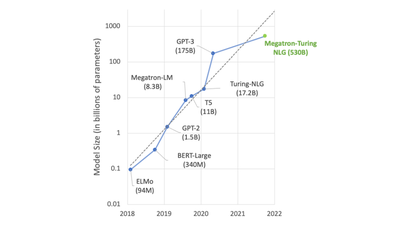

また上記に加え, 基盤モデルの性能として, スケーリング則と呼ばれるものが注目されています.

スケーリング則を説明するにあたり, 以下3つの変数が重要になってきます.

- 訓練ステップ

- データセットサイズ

- パラメータ数

現状, これら3変数を大きくすればするほどに基盤モデルの性能が向上することが示唆されています.つまり, データ数とモデルを大規模にすればするほど, 性能が向上しています.

以上から, 多様かつ大規模なデータで学習した大規模モデルである基盤モデルは, 大規模なデータで学習するために, 表現力が高く, 幅広い応用が可能となっている. また, データを大規模にすればするほど, 性能が向上することが示唆されている. AI開発は「単一タスク- 専用のモデル開発」から「基盤モデルを汎化させる」開発方法に移行しつつあります.

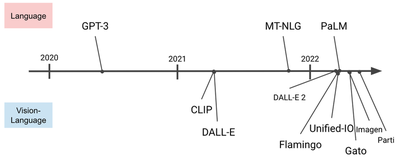

▷ 基盤モデルの例

実際にどのような基盤モデルがあるのか?という所を少しお話させて頂きます.

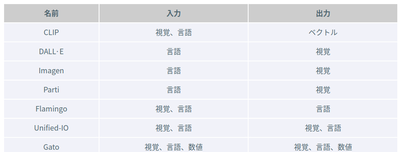

以下にGPT-3以降の代表的な基盤モデルと基盤モデルの入出力関係について記載します.

基盤モデルの例

基盤モデルの入出力関係

上記のように基盤モデルは様々な種類があり, 用途により使用する基盤モデルを選択します.

*実際に我々TRAILもCLIP(Contrastive Language-Image Pretraining)と呼ばれる基盤モデルを活用しています. CLIPは大量の画像・説明文ペアで学習し, ゼロショットで画像分類.

☆ 基盤モデルのロボティクスへの活用例

以下に基盤モデルをロボティクスへ活用した事例を一部列挙します.

良ければ覗いてみてください!

▷ PaLM-SayCan

モデル:Language ModelのPaLM(Pathways Language Model)を活用.

参考サイト:PaLM-SayCan

▷ Code as Policies

実際に言語指示で動かしてみました.

- put the blue block on the yellow bowl

- put the blue block on the green bowl

参考サイト:Code as Policies

▷CLIP-Fields

モデル:Detic, CLIP, Sentence BERTを活用.

参考サイト:CLIP-Fields: Weakly Supervised Semantic Fields for Robotic Memory

☆おわりに

この度は, TRAILのBlogをお読み頂き, また「基盤モデル×Robotics」のAdvent Calendarに興味を持って頂き, ありがとうございました!

TRAIL (Tokyo Robotics and AI Lab) は東京大学松尾豊研究室のサブグループであり, 実世界での知能の実現を目指して,ロボット学習を中心とした研究開発活動を行なっています.

本記事は, TRAILの小林聖人が担当させて頂きました.

今後共, 何卒よろしくお願いします.

☆参考文献

- On the Opportunities and Risks of Foundation Models

- コンピュータビジョン最前線 Summer 2022

- AI開発の新たなパラダイム「基盤モデル」とは

- メタサーベイ 基盤モデル / Foundation Models

- 転移学習・ファインチューニングとは

- PytorchTransformerを実装する

- Do As I Can, Not As I Say:Grounding Language in Robotic Affordances

- Code as Policies

- CLIP-Fields: Weakly Supervised Semantic Fields for Robotic Memory